Nell'attuale esplosione di video brevi, formazione online e contenuti autoprodotti, sempre più creatori si affidano a strumenti di sottotitolazione automatizzati per migliorare la leggibilità dei contenuti e l'efficienza della distribuzione. Ma sai davvero: Quale intelligenza artificiale genera questi sottotitoli? Qual è la loro accuratezza, intelligenza e la tecnologia che li supporta?

In qualità di creatore di contenuti che ha utilizzato diversi strumenti per la creazione di sottotitoli, in questo articolo analizzerò i principi, i modelli principali, gli scenari applicativi, i vantaggi e gli svantaggi della tecnologia di intelligenza artificiale per la generazione di sottotitoli, basandomi sulla mia esperienza di test. Se desiderate rendere i vostri sottotitoli più professionali, accurati e supportare l'output multilingue, questo articolo vi fornirà una risposta completa e pratica.

Sommario

Che cos'è l'intelligenza artificiale dei sottotitoli?

Con il rapido sviluppo del video digitale, la generazione di sottotitoli ha da tempo smesso di basarsi sul noioso processo di digitazione manuale. La produzione di sottotitoli tradizionale è entrata nella fase dell'intelligenza artificiale. Cos'è l'intelligenza artificiale per i sottotitoli? Quale tecnologia utilizza? E quali sono le tipologie più diffuse?

L'intelligenza artificiale per la generazione di sottotitoli si riferisce solitamente a un sistema intelligente basato sulle due tecnologie principali seguenti:

- ASR (riconoscimento automatico del parlato): utilizzato per trascrivere accuratamente il contenuto vocale di video e audio in testo.

- PNL (elaborazione del linguaggio naturale): utilizzato per dividere le frasi, aggiungere punteggiatura e ottimizzare la logica del linguaggio per rendere i sottotitoli generati più leggibili e semanticamente completi.

Con la combinazione dei due, l'intelligenza artificiale può riconoscere automaticamente contenuto vocale → generare in modo sincrono il testo dei sottotitoli → allineare accuratamente con il codice temporale. Ciò consente la generazione efficiente di sottotitoli standard (ad esempio .srt, .vtt, ecc.) senza la necessità di dettatura umana.

Questo è esattamente il tipo di tecnologia AI per i sottotitoli comunemente utilizzata da piattaforme globali come YouTube, Netflix, Coursera, Tiktok, ecc.

Tre tipi principali di intelligenza artificiale per i sottotitoli

| Tipo | Strumenti/Tecnologie rappresentative | Descrizione |

|---|---|---|

| 1. Riconoscimento AI | OpenAI Whisper, la conversione di voce in testo di Google Cloud | Si concentra sulla trascrizione vocale in testo, elevata precisione e supporto multilingue |

| 2. Traduzione AI | DeepL, Google Translate, Meta NLLB | Utilizzato per tradurre i sottotitoli in più lingue, si basa sulla comprensione del contesto |

| 3. Generazione + modifica AI | Easysub (approccio multi-modello integrato) | Combina riconoscimento, traduzione e allineamento temporale con output modificabile; ideale per i creatori di contenuti |

Come funziona l'intelligenza artificiale per i sottotitoli?

Vi siete mai chiesti come l'intelligenza artificiale "capisca" i contenuti video e generi sottotitoli accurati? In realtà, il processo di generazione dei sottotitoli da parte dell'intelligenza artificiale è molto più intelligente e sistematico di quanto si pensi. Non si tratta semplicemente di "“audio in testo”, ma una combinazione di sottotecnologie di intelligenza artificiale, elaborate in più fasi e ottimizzate strato per strato, per produrre un file di sottotitoli realmente utilizzabile, leggibile ed esportabile.

Di seguito spiegheremo in dettaglio il processo completo di generazione automatica dei sottotitoli tramite IA.

Fase 1: Riconoscimento vocale (ASR - Riconoscimento vocale automatico)

Questo è il primo e più importante passaggio nella generazione dei sottotitoli.Il sistema di intelligenza artificiale acquisisce l'input vocale dal video o dall'audio e lo analizza attraverso un modello di deep learning per riconoscere il contenuto testuale di ogni frase. Tecnologie tradizionali come OpenAI Whisper e Google Speech-to-Text vengono addestrate su dati vocali multilingue su larga scala.

-1024x598.png)

Fase 2: Elaborazione del linguaggio naturale (NLP)

L'intelligenza artificiale è in grado di riconoscere il testo, ma spesso si tratta di "linguaggio macchina", senza punteggiatura, senza interruzioni di frase e con scarsa leggibilità.Il compito del modulo NLP è quello di eseguire l'elaborazione logica linguistica sul testo riconosciuto, tra cui:

- Aggiungere punteggiatura (punti, virgole, punti interrogativi, ecc.)

- Dividere le espressioni naturali (ogni sottotitolo è di lunghezza ragionevole e facile da leggere)

- Correggere gli errori grammaticali per migliorare la fluidità

Questo passaggio è solitamente combinato con la modellazione della comprensione semantica contestuale e del corpus per rendere i sottotitoli più simili a "“frasi umane”.

Fase 3: Allineamento del timecode

I sottotitoli non sono solo testo, devono essere sincronizzati con precisione con il contenuto video. In questa fase, l'IA analizzerà l'inizio e la fine del discorso per generare dati cronologici (timecode di inizio/fine) per ciascun sottotitolo, al fine di ottenere la "sincronizzazione di suono e parole".

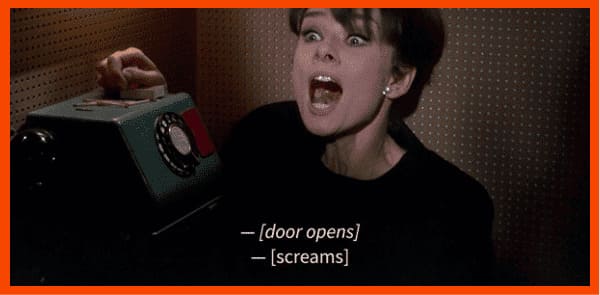

Fase 4: Formato di output dei sottotitoli (ad esempio SRT / VTT / ASS, ecc.)

Dopo aver elaborato il testo e il timecode, il sistema converte il contenuto dei sottotitoli in un formato standardizzato per facilitarne l'esportazione, la modifica o il caricamento sulla piattaforma. I formati più comuni includono:

- .srt: formato di sottotitoli comune, supporta la maggior parte delle piattaforme video

- .vtt: per video HTML5, supporta i lettori web

- .ass: supporta stili avanzati (colore, carattere, posizione, ecc.)

💡 Easysub supporta l'esportazione multiformato per soddisfare le esigenze dei creatori su diverse piattaforme come YouTube, B-station, TikTok e così via.

Modelli di tecnologia AI per i sottotitoli tradizionali

Con la continua evoluzione della tecnologia di sottotitolazione automatica, anche i modelli di intelligenza artificiale che la supportano stanno rapidamente evolvendo. Dal riconoscimento vocale alla comprensione del linguaggio, dalla traduzione all'output strutturato, le principali aziende tecnologiche e i laboratori di intelligenza artificiale hanno sviluppato diversi modelli altamente maturi.

Per i creatori di contenuti, comprendere questi modelli tradizionali aiuterà a determinare la potenza tecnica degli strumenti di sottotitolazione e a scegliere la piattaforma più adatta alle proprie esigenze (come Easysub).

| Modello / Strumento | Organizzazione | Funzione principale | Descrizione dell'applicazione |

|---|---|---|---|

| Sussurro | OpenAI | ASR multilingue | Riconoscimento open source ad alta precisione per sottotitoli multilingue |

| Google STT | Google Cloud | API di conversione da voce a testo | API cloud stabile, utilizzata nei sistemi di sottotitoli a livello aziendale |

| Meta NLLB | Meta-IA | Traduzione neurale | Supporta oltre 200 lingue, adatto alla traduzione dei sottotitoli |

| Traduttore DeepL | DeepL GmbH | MT di alta qualità | Traduzioni naturali e accurate per sottotitoli professionali |

| Flusso AI Easysub | Easysub (il tuo marchio) | AI per sottotitoli end-to-end | Flusso integrato ASR + NLP + Timecode + Traduzione + Editing |

Sfide e soluzioni per la tecnologia AI per i sottotitoli automatici

Sebbene generazione automatica dei sottotitoli Sebbene abbia compiuto progressi straordinari, deve ancora affrontare numerose sfide tecniche e limitazioni nelle applicazioni pratiche. Soprattutto in presenza di contenuti multilingue e complessi, accenti diversi o ambienti video rumorosi, la capacità dell'IA di "ascoltare, comprendere e scrivere" non è sempre perfetta.

In qualità di creatore di contenuti che utilizza nella pratica strumenti di intelligenza artificiale per i sottotitoli, ho riassunto alcuni problemi tipici del processo di utilizzo e, allo stesso tempo, ho anche studiato come strumenti e piattaforme, tra cui Easysub, affrontano queste sfide.

Sfida 1: Accenti, dialetti e linguaggio ambiguo interferiscono con la precisione del riconoscimento

Anche con modelli di riconoscimento vocale all'avanguardia, i sottotitoli possono essere riconosciuti in modo errato a causa di una pronuncia non standard, di una mescolanza di dialetti o di rumori di fondo. Tra i fenomeni più comuni figurano:

- I video in inglese con accenti indiani, del sud-est asiatico o africani possono creare confusione.

- Mancano parzialmente i video cinesi con dialetto cantonese, taiwanese o sichuan.

- Gli ambienti video rumorosi (ad esempio all'aperto, in conferenza, in streaming live) impediscono all'intelligenza artificiale di distinguere accuratamente le voci umane.

La soluzione di Easysub:

Adotta un algoritmo di riconoscimento basato sulla fusione multi-modello (inclusi Whisper e modelli locali sviluppati autonomamente). Migliora la precisione del riconoscimento tramite il rilevamento della lingua + riduzione del rumore di fondo + meccanismo di compensazione del contesto.

Sfida 2: la struttura complessa del linguaggio porta a interruzioni di frase irragionevoli e a sottotitoli difficili da leggere.

Se il testo trascritto dall'IA manca di punteggiatura e ottimizzazione strutturale, spesso sembra che l'intero paragrafo sia collegato senza alcuna pausa, e persino il significato della frase risulta troncato. Ciò compromette seriamente la comprensione del pubblico.

La soluzione di Easysub:

Easysub ha un modulo NLP (Natural Language Processing) integrato. Utilizza un modello linguistico pre-addestrato per suddividere in modo intelligente le frasi, la punteggiatura e l'omogeneizzazione semantica del testo originale, per generare sottotitoli più in linea con le abitudini di lettura.

Sfida 3: Accuratezza insufficiente della traduzione dei sottotitoli multilingue

Quando si traducono i sottotitoli in inglese, giapponese, spagnolo, ecc., l'intelligenza artificiale tende a produrre frasi meccaniche, rigide e fuori contesto a causa della mancanza di contesto.

La soluzione di Easysub:

Easysub si integra con il sistema di traduzione multi-modello DeepL/NLLB e consente agli utenti di eseguire la correzione di bozze manuale post-traduzione e la modifica in modalità di riferimento incrociato multilingue.

Sfida 4: Formati di output non armonizzati

Alcuni strumenti per sottotitoli forniscono solo un output di testo di base e non possono esportare formati standard come .srt, .vtt, .ass. Questo costringerà gli utenti a convertire manualmente i formati, il che inciderà sull'efficienza d'uso.

La soluzione di Easysub:

supporta l'esportazione file dei sottotitoli in più formati e cambiando stile con un solo clic, il che garantisce che i sottotitoli possano essere applicati senza problemi su tutte le piattaforme.

-1024x351.png)

Quali settori sono più adatti agli strumenti di sottotitolazione basati sull'intelligenza artificiale?

Strumenti di sottotitolazione automatizzati basati sull'intelligenza artificiale Non sono riservati solo a YouTuber o videoblogger. Con la crescente popolarità e globalizzazione dei contenuti video, sempre più settori si stanno affidando ai sottotitoli basati sull'intelligenza artificiale per aumentare l'efficienza, raggiungere il pubblico e migliorare la professionalità.

- Formazione e addestramento (corsi online / video didattici / registrazioni di lezioni)

- Comunicazione e formazione interna aziendale (registri delle riunioni / video di formazione interna / report di progetto)

- Brevi video esteri e contenuti di e-commerce transfrontalieri (YouTube / TikTok / Instagram)

- Industria della produzione cinematografica e dei media (documentari / interviste / post-produzione)

- Sviluppatori di piattaforme di formazione online / strumenti SaaS (contenuti B2B + video dimostrativi di prodotti)

Perché consigli Easysub e cosa lo differenzia dagli altri strumenti di sottotitolazione?

Esistono numerosi strumenti per i sottotitoli sul mercato, dai sottotitoli automatici di YouTube ai plug-in dei software di editing professionali, fino ad alcuni semplici strumenti di traduzione... Ma molte persone scopriranno che, durante il loro utilizzo:

- Alcuni strumenti non hanno un tasso di riconoscimento elevato e le frasi risultano in qualche modo interrotte.

- Alcuni strumenti non possono esportare file di sottotitoli e non possono essere utilizzati due volte.

- Alcuni strumenti hanno una qualità di traduzione scadente e non si leggono bene.

- Alcuni strumenti hanno interfacce complesse e poco intuitive, difficili da usare anche per l'utente medio.

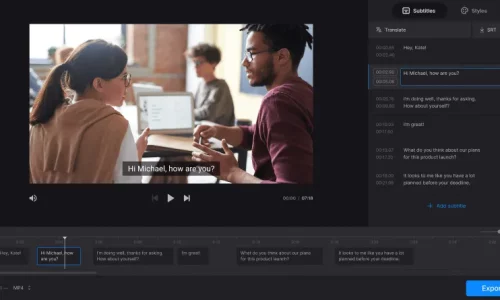

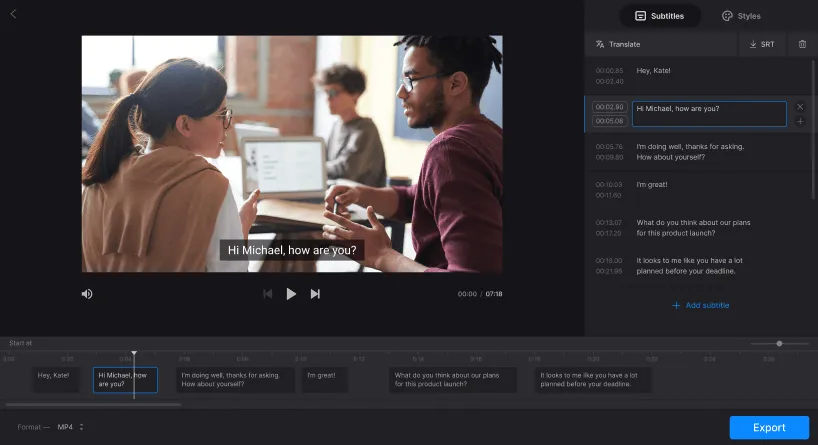

Come creatore video di lunga data, ho testato molti strumenti per sottotitoli e alla fine ho scelto e consigliato Easysub. Perché offre davvero i seguenti 4 vantaggi:

- Riconosce con precisione il parlato multilingue e si adatta a diversi accenti e contesti.

- Editor visivo dei sottotitoli + regolazione manuale, flessibile e controllabile.

- Supporta la traduzione in oltre 30 lingue, adatto agli utenti stranieri e multilingue.

- Gamma completa di formati di output, compatibili con tutte le principali piattaforme e strumenti di editing

| Categoria di funzionalità | Easysub | Sottotitoli automatici di YouTube | Modifica manuale dei sottotitoli | Strumenti generali per sottotitoli AI |

|---|---|---|---|---|

| Precisione del riconoscimento vocale | ✅ Alto (supporto multilingue) | Medio (adatto per l'inglese) | Dipende dal livello di abilità | Media |

| Supporto alla traduzione | ✅ Sì (oltre 30 lingue) | ❌ Non supportato | ❌ Traduzione manuale | ✅ Parziale |

| Modifica dei sottotitoli | ✅ Editor visivo e messa a punto | ❌ Non modificabile | ✅ Controllo completo | ❌ UX di editing scadente |

| Formati di esportazione | ✅ srt / vtt / ass supportati | ❌ Nessuna esportazione | ✅ Flessibile | ❌ Formati limitati |

| Facilità d'uso dell'interfaccia utente | ✅ Interfaccia utente semplice e multilingue | ✅ Molto basilare | ❌ Flusso di lavoro complesso | ❌ Spesso solo in inglese |

| Contenuto cinese amichevole | ✅ Altamente ottimizzato per CN | ⚠️ Necessita di miglioramenti | ✅ Con impegno | ⚠️ Traduzione innaturale |

Inizia a usare EasySub per migliorare i tuoi video oggi stesso

Nell'era della globalizzazione dei contenuti e dell'esplosione dei video di breve durata, la sottotitolazione automatica è diventata uno strumento fondamentale per migliorare la visibilità, l'accessibilità e la professionalità dei video.

Con piattaforme di generazione di sottotitoli AI come Easysub, i creatori di contenuti e le aziende possono produrre sottotitoli video di alta qualità, multilingue e accuratamente sincronizzati in meno tempo, migliorando notevolmente l'esperienza visiva e l'efficienza della distribuzione.

Nell'era della globalizzazione dei contenuti e dell'esplosione dei video in formato breve, la sottotitolazione automatica è diventata uno strumento chiave per migliorare la visibilità, l'accessibilità e la professionalità dei video. Grazie a piattaforme di generazione di sottotitoli basate sull'intelligenza artificiale come Easysub, i creatori di contenuti e le aziende possono produrre sottotitoli video di alta qualità, multilingue e accuratamente sincronizzati in meno tempo, migliorando notevolmente l'esperienza visiva e l'efficienza della distribuzione.

Che tu sia un principiante o un creator esperto, Easysub può accelerare e potenziare i tuoi contenuti. Prova Easysub gratuitamente ora e scopri l'efficienza e l'intelligenza dei sottotitoli basati sull'intelligenza artificiale, che consentono a ogni video di raggiungere un pubblico globale, superando i confini linguistici!

Lascia che l'intelligenza artificiale potenzi i tuoi contenuti in pochi minuti!

👉 Clicca qui per una prova gratuita: easyssub.com

Grazie per aver letto questo blog. Non esitate a contattarci per ulteriori domande o esigenze di personalizzazione!