Face à l'explosion actuelle des vidéos courtes, de la formation en ligne et des contenus autoproduits, de plus en plus de créateurs font appel aux outils de sous-titrage automatique pour améliorer la lisibilité de leurs contenus et optimiser leur diffusion. Mais savez-vous vraiment : Quelle IA génère ces sous-titres ? Quels sont leur niveau de précision, leur intelligence et la technologie qui les sous-tend ?

En tant que créateur de contenu ayant utilisé divers outils de sous-titrage, j'analyserai dans cet article les principes, les modèles clés, les cas d'utilisation, ainsi que les avantages et les inconvénients de l'IA de génération de sous-titres, en m'appuyant sur ma propre expérience. Si vous souhaitez créer des sous-titres plus professionnels, plus précis et compatibles avec plusieurs langues, cet article vous apportera une réponse complète et pratique.

Table des matières

Qu'est-ce que l'IA des sous-titres ?

Avec le développement rapide de la vidéo numérique, la génération de sous-titres ne repose plus depuis longtemps sur la saisie manuelle fastidieuse. La production de sous-titres s'appuie désormais sur l'intelligence artificielle. Mais qu'est-ce que l'IA pour les sous-titres ? Quelles technologies utilise-t-elle ? Et quels sont les principaux types d'IA ?

L'IA de génération de sous-titres désigne généralement un système intelligent construit sur les deux technologies de base suivantes :

- ASR (reconnaissance automatique de la parole): utilisé pour transcrire avec précision le contenu vocal des vidéos et des fichiers audio en texte.

- PNL (traitement du langage naturel): utilisé pour découper les phrases, ajouter la ponctuation et optimiser la logique linguistique afin de rendre les sous-titres générés plus lisibles et sémantiquement complets.

Grâce à la combinaison des deux, l'IA peut reconnaître automatiquement Contenu vocal → génération synchrone des sous-titres → alignement précis avec le timecode. Cela permet la génération efficace de sous-titres standard (par exemple .srt, .vtt, etc.) sans avoir besoin de dictée humaine.

C’est précisément le type de technologie d’IA pour les sous-titres qui est couramment utilisé par les plateformes mondiales telles que YouTube, Netflix, Coursera, TikTok, etc.

Trois principaux types d'IA de sous-titrage

| Taper | Outils/technologies représentatifs | Description |

|---|---|---|

| 1. IA de reconnaissance | OpenAI Whisper, Google Cloud Speech-to-Text | Axé sur la transcription vocale, une grande précision et une prise en charge multilingue |

| 2. IA de traduction | DeepL, Google Traduction, Meta NLLB | Utilisé pour la traduction de sous-titres en plusieurs langues, repose sur la compréhension du contexte. |

| 3. Génération + Édition IA | Easysub (approche multi-modèle intégrée) | Combine la reconnaissance, la traduction et l'alignement temporel avec une sortie modifiable ; idéal pour les créateurs de contenu. |

Comment fonctionne l'IA de sous-titrage ?

Vous êtes-vous déjà demandé comment l'IA “ comprend ” le contenu vidéo et génère des sous-titres précis ? En réalité, le processus de génération de sous-titres par l'IA est bien plus intelligent et systématique que vous ne le pensez. Il ne s'agit pas simplement de…“audio en texte” », mais une combinaison de sous-technologies d’IA, traitées par étapes et optimisées couche par couche, pour produire un fichier de sous-titres véritablement utilisable, lisible et exportable.

Nous allons expliquer ci-dessous en détail le processus complet de Génération automatique de sous-titres par IA.

Étape 1 : Reconnaissance vocale (ASR - Reconnaissance vocale automatique)

Il s'agit de la première et de la plus importante étape de la génération de sous-titres.Le système d'IA extrait la parole d'une vidéo ou d'un enregistrement audio et l'analyse grâce à un modèle d'apprentissage profond afin de reconnaître le contenu textuel de chaque phrase. Les technologies courantes telles qu'OpenAI Whisper et Google Speech-to-Text sont entraînées sur de vastes bases de données vocales multilingues.

-1024x598.png)

Étape 2 : Traitement automatique du langage naturel (TALN)

L'IA peut reconnaître du texte, mais il s'agit souvent d'un “ langage machine ” sans ponctuation, sans césure et avec une faible lisibilité.La tâche du module NLP est d'effectuer un traitement logique linguistique sur le texte reconnu., y compris:

- Ajout de la ponctuation (points, virgules, points d'interrogation, etc.)

- Découpage des énoncés naturels (chaque sous-titre est d'une longueur raisonnable et facile à lire)

- Corriger les erreurs grammaticales pour améliorer la fluidité

Cette étape est généralement combinée à la modélisation de la compréhension sémantique du corpus et du contexte pour rendre les sous-titres plus semblables à “peines humaines”.

Étape 3 : Alignement du code temporel

Les sous-titres ne sont pas qu'un simple texte, ils doivent être parfaitement synchronisés avec le contenu vidéo.. Dans cette étape, l'IA analysera les heures de début et de fin du discours afin de générer des données de chronologie (code temporel de début/fin) pour chaque sous-titre afin de réaliser la “ synchronisation du son et des mots ”.

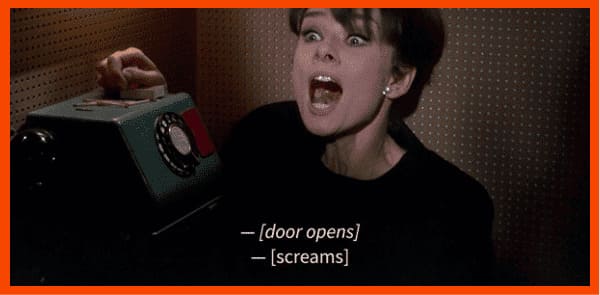

Étape 4 : Format de sortie des sous-titres (par exemple SRT / VTT / ASS, etc.)

Après le traitement du texte et du timecode, le système convertit le contenu des sous-titres dans un format standardisé facilitant l'exportation, la modification ou le chargement sur la plateforme. Les formats courants incluent :

- .srt: format de sous-titres courant, compatible avec la plupart des plateformes vidéo

- .vtt : pour la vidéo HTML5, compatible avec les lecteurs web

- .ass : prend en charge les styles avancés (couleur, police, position, etc.)

💡 Easysub Il prend en charge l'exportation multiformat pour répondre aux besoins des créateurs sur différentes plateformes telles que YouTube, B-station, TikTok, etc.

Modèles technologiques d'IA de sous-titrage courants

À mesure que la technologie de sous-titrage automatique évolue, les modèles d'IA qui la sous-tendent progressent rapidement. De la reconnaissance vocale à la compréhension du langage, en passant par la traduction et la production de données structurées, les grandes entreprises technologiques et les laboratoires d'IA ont développé plusieurs modèles très aboutis.

Pour les créateurs de contenu, comprendre ces modèles courants vous aidera à déterminer la robustesse technique des outils de sous-titrage et à choisir la plateforme qui correspond le mieux à vos besoins (comme Easysub).

| Modèle / Outil | Organisation | Fonction principale | Description de l'application |

|---|---|---|---|

| Chuchoter | OpenAI | Reconnaissance automatique multilingue | Reconnaissance open source de haute précision pour les sous-titres multilingues |

| Google STT | Google Cloud | API de conversion vocale en texte | API cloud stable, utilisée dans les systèmes de sous-titrage d'entreprise |

| Meta NLLB | Méta IA | Traduction neuronale | Prend en charge plus de 200 langues, convient à la traduction de sous-titres |

| Traducteur DeepL | DeepL GmbH | MT de haute qualité | Traductions naturelles et précises pour des sous-titres professionnels |

| Flux d'IA Easysub | Easysub (Votre marque) | IA de sous-titrage de bout en bout | Flux intégré de reconnaissance vocale automatique (ASR) + traitement du langage naturel (NLP) + timecode + traduction + édition |

Défis et solutions pour la technologie d'IA de sous-titrage automatique

Bien que génération automatique de sous-titres Bien qu'elle ait réalisé des progrès remarquables, l'IA se heurte encore à de nombreux défis techniques et à des limitations dans ses applications pratiques. Notamment dans les environnements multilingues, les contenus complexes, les accents variés ou les environnements vidéo bruyants, sa capacité à “ écouter, comprendre et écrire ” n'est pas toujours parfaite.

En tant que créateur de contenu utilisant concrètement des outils d'IA pour les sous-titres, j'ai résumé quelques problèmes typiques rencontrés lors de leur utilisation et, parallèlement, j'ai également étudié comment les outils et les plateformes, notamment Easysub, relèvent ces défis.

Défi 1 : Les accents, les dialectes et les ambiguïtés dans la parole nuisent à la précision de la reconnaissance.

Même avec les modèles de reconnaissance vocale les plus performants, les sous-titres peuvent être mal interprétés en raison d'une prononciation non standard, d'un mélange de dialectes ou de bruits de fond. Parmi les phénomènes courants, on peut citer :

- Les vidéos en anglais avec des accents indiens, d'Asie du Sud-Est ou africains peuvent être déroutantes.

- Des vidéos chinoises en cantonais, taïwanais ou sichuanais sont partiellement manquantes.

- Les environnements vidéo bruyants (par exemple, en extérieur, en conférence, en streaming en direct) rendent impossible pour l'IA de séparer avec précision les voix humaines.

La solution d'Easysub :

Utilise un algorithme de reconnaissance par fusion multi-modèles (incluant Whisper et des modèles développés en interne). Améliore la précision de la reconnaissance grâce à la détection de la langue, la réduction du bruit de fond et un mécanisme de compensation du contexte.

Défi 2 : La complexité de la structure linguistique entraîne des coupures de phrases incohérentes et des sous-titres difficiles à lire.

Si le texte transcrit par l'IA manque de ponctuation et d'optimisation structurelle, il apparaît souvent que les paragraphes sont enchaînés sans aucune pause, et le sens des phrases est même tronqué. Cela nuit gravement à la compréhension du lecteur.

La solution d'Easysub :

Easysub intègre un module de traitement automatique du langage naturel (TALN). Ce module utilise un modèle de langage pré-entraîné pour segmenter intelligemment les phrases, corriger la ponctuation et lisser sémantiquement le texte original afin de générer des sous-titres plus naturels et adaptés aux habitudes de lecture.

Défi 3 : Précision insuffisante de la traduction des sous-titres multilingues

Lors de la traduction de sous-titres en anglais, japonais, espagnol, etc., l'IA a tendance à produire des phrases mécaniques, rigides et hors contexte en raison du manque de contexte.

La solution d'Easysub :

Easysub s'intègre au système de traduction multi-modèles DeepL / NLLB et permet aux utilisateurs d'effectuer une relecture manuelle post-traduction et une édition en mode de référencement croisé multilingue.

Défi 4 : Formats de sortie non harmonisés

Certains logiciels de sous-titrage ne proposent qu'une sortie texte basique et ne peuvent pas exporter les formats standards tels que .srt, .vtt ou .ass. Les utilisateurs sont alors contraints de convertir manuellement les formats, ce qui nuit à l'efficacité du logiciel.

La solution d'Easysub :

prend en charge l'exportation fichiers de sous-titres dans de multiples formats et avec la possibilité de changer de style en un seul clic, ce qui garantit une application fluide des sous-titres sur toutes les plateformes.

-1024x351.png)

Quels secteurs sont les mieux adaptés aux outils de sous-titrage par IA ?

outils de sous-titrage automatique par IA Le sous-titrage par IA n'est pas réservé aux YouTubeurs ou aux vidéastes. Avec la popularité croissante et la mondialisation des contenus vidéo, de plus en plus de secteurs se tournent vers cette technologie pour gagner en efficacité, toucher un public plus large et améliorer leur professionnalisme.

- Éducation et formation (cours en ligne / vidéos pédagogiques / enregistrements de conférences)

- Communication interne et formation de l'entreprise (comptes rendus de réunions / vidéos de formation interne / rapports de projet)

- Vidéos courtes internationales et contenu e-commerce transfrontalier (YouTube / TikTok / Instagram)

- Industrie des médias et de la production cinématographique (documentaire / interview / post-production)

- Plateforme de formation en ligne / Développeurs d'outils SaaS (contenu B2B + vidéos de démonstration de produits)

Pourquoi recommandez-vous Easysub et qu'est-ce qui le différencie des autres outils de sous-titrage ?

Il existe de nombreux outils de sous-titrage sur le marché, allant des sous-titres automatiques de YouTube aux plugins de logiciels de montage professionnels, en passant par de simples outils de traduction… Mais beaucoup de personnes constateront qu’en les utilisant :

- Certains outils n'ont pas un taux de reconnaissance élevé, et les phrases sont parfois mal interprétées.

- Certains outils ne permettent pas d'exporter les fichiers de sous-titres et ne peuvent pas être utilisés deux fois.

- Certains outils offrent une qualité de traduction médiocre et une lecture difficile.

- Certains outils possèdent des interfaces complexes et peu conviviales, difficiles à utiliser pour l'utilisateur moyen.

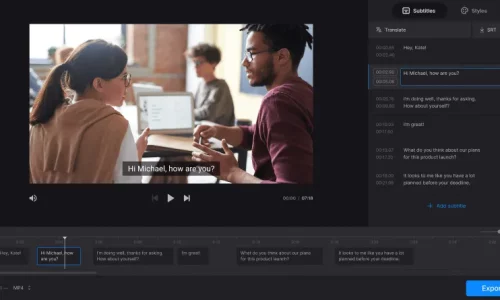

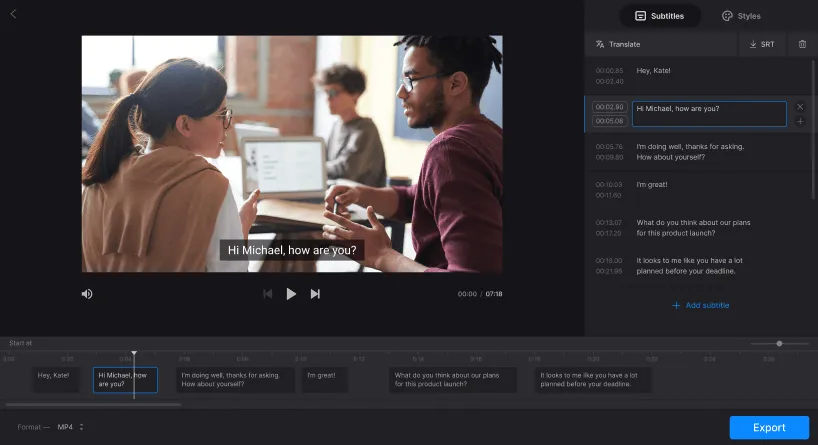

Créateur de vidéos depuis longtemps, j'ai testé de nombreux outils de sous-titrage et j'ai finalement choisi Easysub, que je recommande. Il présente en effet quatre avantages majeurs :

- Reconnaît avec précision la parole multilingue et s'adapte aux différents accents et contextes.

- Éditeur visuel de sous-titres + réglages manuels précis, flexible et contrôlable.

- Prise en charge de la traduction dans plus de 30 langues, adaptée aux utilisateurs étrangers et multilingues.

- Gamme complète de formats de sortie, compatible avec toutes les principales plateformes et outils de montage

| Catégorie de fonctionnalité | Easysub | Sous-titres automatiques YouTube | Édition manuelle des sous-titres | Outils généraux d'IA pour le sous-titrage |

|---|---|---|---|---|

| Précision de la reconnaissance vocale | ✅ Haute qualité (prise en charge multilingue) | Niveau moyen (Bien adapté à l'anglais) | Cela dépend du niveau de compétence | Moyenne |

| Assistance à la traduction | ✅ Oui (plus de 30 langues) | ❌ Non pris en charge | ❌ Traduction manuelle | ✅ Partiel |

| Édition de sous-titres | ✅ Éditeur visuel et réglages précis | ❌ Non modifiable | ✅ Contrôle total | ❌ Mauvaise expérience utilisateur d'édition |

| Formats d'exportation | ✅ Compatible SRT / VTT / ASS | ❌ Aucune exportation | ✅ Flexible | ❌ Formats limités |

| Convivialité de l'interface utilisateur | ✅ Interface utilisateur simple et multilingue | ✅ Très basique | ❌ Flux de travail complexe | ❌ Souvent uniquement en anglais |

| Contenu chinois convivial | ✅ Hautement optimisé pour la Chine | ⚠️ Nécessite des améliorations | ✅ Avec effort | ⚠️ Traduction non naturelle |

Commencez à utiliser EasySub pour améliorer vos vidéos dès aujourd'hui

À l’ère de la mondialisation des contenus et de l’explosion des vidéos de courte durée, le sous-titrage automatisé est devenu un outil essentiel pour améliorer la visibilité, l’accessibilité et le professionnalisme des vidéos.

Avec des plateformes de génération de sous-titres IA comme Easysub, Les créateurs de contenu et les entreprises peuvent produire des sous-titres vidéo de haute qualité, multilingues et synchronisés avec précision en moins de temps, améliorant considérablement l'expérience de visionnage et l'efficacité de la distribution.

À l'ère de la mondialisation des contenus et de l'explosion des vidéos courtes, le sous-titrage automatisé est devenu un outil essentiel pour améliorer la visibilité, l'accessibilité et le professionnalisme des vidéos. Grâce aux plateformes de génération de sous-titres par IA comme Easysub, les créateurs de contenu et les entreprises peuvent produire des sous-titres vidéo de haute qualité, multilingues et parfaitement synchronisés en un temps record, améliorant ainsi considérablement l'expérience de visionnage et l'efficacité de la distribution.

Que vous soyez débutant ou créateur expérimenté, Easysub peut accélérer et dynamiser votre contenu. Essayez Easysub gratuitement dès maintenant et découvrez l'efficacité et l'intelligence du sous-titrage par IA, permettant à chaque vidéo de toucher un public international, au-delà des frontières linguistiques !

Laissez l'IA dynamiser votre contenu en quelques minutes seulement !

👉Cliquez ici pour un essai gratuit : easyssub.com

Merci d'avoir lu ce blog. N'hésitez pas à nous contacter pour plus de questions ou besoins de personnalisation !