À l'ère du numérique, le sous-titrage automatique est devenu une composante essentielle du contenu vidéo. Il améliore non seulement la compréhension des spectateurs, mais il est également crucial pour l'accessibilité et la diffusion internationale.

Mais une question fondamentale demeure : “ Quelle est la précision du sous-titrage automatique ?”La précision des sous-titres influe directement sur la crédibilité de l'information et l'efficacité de sa diffusion. Cet article analysera les performances réelles du sous-titrage automatique en examinant les dernières technologies de reconnaissance vocale, des données comparatives issues de différentes plateformes et les retours d'expérience des utilisateurs. Nous partagerons également l'expertise d'Easysub en matière d'amélioration de la qualité des sous-titres.

Table des matières

Comment fonctionne la technologie de sous-titrage automatique ?

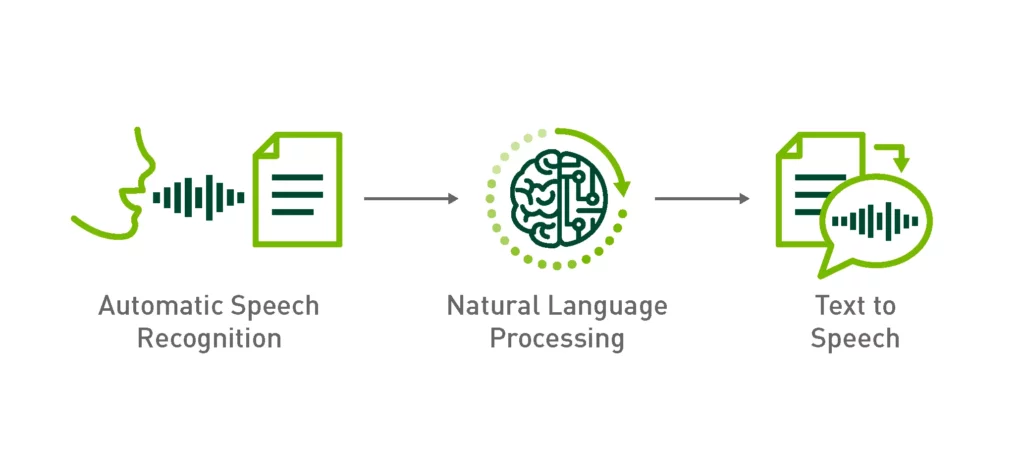

Pour comprendre “ Quelle est la précision du sous-titrage automatique ? ”, il faut d’abord saisir comment les sous-titres automatiques sont générés. À la base, le sous-titrage automatique repose sur la technologie de reconnaissance automatique de la parole (ASR), qui utilise l'intelligence artificielle et les modèles de traitement du langage naturel pour convertir le contenu parlé en texte.

1. Processus de base

- Entrée audio:Le système reçoit des signaux audio provenant de vidéos ou de flux en direct.

- Reconnaissance vocale (ASR):Utilise des modèles acoustiques et des modèles linguistiques pour segmenter et reconnaître la parole en mots ou en caractères.

- Compréhension du langage:Certains systèmes avancés intègrent une sémantique contextuelle pour réduire les erreurs causées par les homophones ou les accents.

- Synchronisation des sous-titres:Le texte généré est automatiquement aligné sur la chronologie, formant des légendes lisibles.

2. Approches techniques courantes

- Méthodes ASR traditionnelles:S'appuie sur des caractéristiques statistiques et acoustiques, adaptées à la parole standard mais limitées en précision dans des environnements complexes.

- Apprentissage profond et modèle de langage étendu (LLM) - ASR piloté:En utilisant les réseaux neuronaux et l’inférence contextuelle, ces modèles reconnaissent mieux les accents, la parole multilingue et les conversations naturelles, représentant l’orientation dominante actuelle de la technologie de sous-titrage automatique.

3. Limitations techniques

- Le bruit de fond, les conversations à plusieurs locuteurs, les dialectes et la vitesse de parole excessive ont tous un impact sur la précision de la reconnaissance.

- Les technologies existantes ont encore du mal à atteindre une précision proche de 100% dans tous les scénarios.

En tant que marque spécialisée dans la génération et l'optimisation de sous-titres, Easysub intègre des mécanismes d'apprentissage profond et de post-traitement dans des applications pratiques pour réduire les erreurs dans une certaine mesure, offrant aux utilisateurs des solutions de sous-titres de meilleure qualité.

Mesurer la précision du sous-titrage automatique

Pour débattre de la précision du sous-titrage automatique, nous avons besoin de normes de mesure scientifiques. La précision des sous-titres ne se limite pas à leur apparence, mais repose sur des méthodes et des indicateurs d'évaluation clairs.

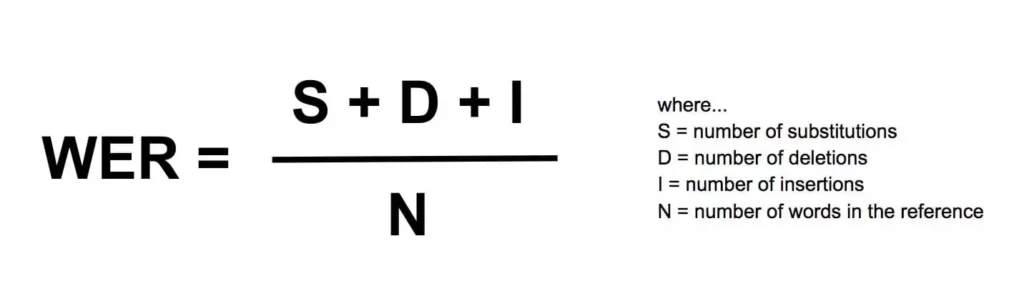

Il s’agit de la mesure la plus couramment utilisée, calculée comme suit :

WER = (Nombre de remplacements + Nombre de suppressions + Nombre d'insertions)/Nombre total de mots

- Substitution: Mauvaise identification d'un mot.

- Effacement:Omettre un mot qui aurait dû être reconnu.

- Insertion:Ajout d'un mot supplémentaire qui n'existe pas.

Par exemple:

- Phrase originale: “ J’adore le sous-titrage automatique. ”

- Résultat de reconnaissance: “ J’aime le sous-titrage automatique. ”

Ici, en remplaçant “amour”" avec "“comme” constitue une substitution incorrecte.

2. SER (taux d'erreur de phrase)

Mesurée au niveau de la phrase, toute erreur dans un sous-titre est comptabilisée comme une erreur de phrase entière. Cette norme plus stricte est couramment utilisée dans les contextes professionnels (par exemple, le sous-titrage juridique ou médical).

3. CER (taux d'erreur de caractère)

Particulièrement adapté à l'évaluation de la précision dans les langues non phonétiques comme le chinois et le japonais. Sa méthode de calcul est similaire à celle du WER, mais utilise les “ caractères ” comme unité de base.

4. Exactitude vs. Compréhensibilité

- Précision: Fait référence à la précision du résultat de la reconnaissance lorsqu'il est comparé mot à mot avec le texte original.

- Compréhensibilité:Si les sous-titres restent compréhensibles pour les téléspectateurs même avec un petit nombre d'erreurs.

Par exemple:

- Résultat de reconnaissance: “ J'adore le sous-titrage automatique. ” (erreur d'orthographe)

Bien que le WER indique une erreur, les spectateurs peuvent toujours en saisir le sens, de sorte que la “ compréhensibilité ” reste élevée dans ce cas.

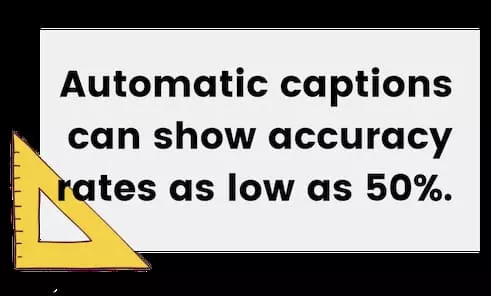

Au sein de l’industrie, un Taux de précision du WER 95% est considéré comme relativement élevé. Cependant, pour des scénarios tels que les contextes juridiques, éducatifs et médiatiques professionnels, un taux de précision approchant 99% est souvent nécessaire pour répondre aux demandes.

En comparaison, les plateformes courantes comme YouTube et ses sous-titres automatiques atteignent des taux de précision élevés. entre 60% et 90%, selon la qualité audio et les conditions de parole. Des outils professionnels comme Easysub, cependant, combinent l’optimisation de l’IA avec la post-édition après la reconnaissance automatique, réduisant considérablement les taux d’erreur.

Facteurs affectant la précision du sous-titrage automatique

À la question “ Quelle est la précision du sous-titrage automatique ? ”, la précision des sous-titres est influencée par de multiples facteurs externes, au-delà de la technologie elle-même. Même les modèles de reconnaissance vocale par IA les plus avancés présentent des variations de performances importantes selon les environnements. Les principaux facteurs d'influence sont les suivants :

Facteur 1. Qualité audio

- Bruit de fond:Les environnements bruyants (par exemple, les rues, les cafés, les événements en direct) interfèrent avec la reconnaissance.

- Équipement d'enregistrement:Les microphones de haute qualité capturent une parole plus claire, améliorant ainsi les taux de reconnaissance.

- Compression audio:De faibles débits binaires ou une compression avec perte dégradent les fonctionnalités sonores, réduisant ainsi l'efficacité de la reconnaissance.

Facteur 2. Caractéristiques des haut-parleurs

- Variations d'accent:Une prononciation non standard ou des accents régionaux peuvent avoir un impact significatif sur la reconnaissance.

- Débit de parole : Un discours excessivement rapide peut entraîner des omissions, tandis qu’un discours excessivement lent peut perturber le flux contextuel.

- Clarté de la prononciation:Une prononciation étouffée ou indistincte pose de plus grands défis de reconnaissance.

Facteur 3. Langues et dialectes

- Diversité linguistique:Les langues courantes (par exemple, l’anglais, l’espagnol) ont généralement des modèles de formation plus matures.

- Dialectes et langues minoritaires:Il manque souvent des corpus à grande échelle, ce qui entraîne une précision nettement inférieure.

- Changement de code:Lorsque plusieurs langues alternent au sein d’une même phrase, des erreurs de reconnaissance se produisent fréquemment.

Facteur 4. Scénarios et types de contenu

- Cadres formels:Comme les cours ou conférences en ligne, où la qualité sonore est bonne et le rythme de la parole modéré, ce qui conduit à des taux de reconnaissance plus élevés.

- Conversations informelles:Les discussions multipartites, les interruptions et les discours qui se chevauchent augmentent la difficulté.

- Terminologie techniqueLes termes spécialisés couramment utilisés dans des domaines comme la médecine, le droit et la technologie peuvent être mal reconnus si le modèle n'a pas été entraîné sur ces termes.

Facteur 5. Différences techniques et de plateforme

Les sous-titres intégrés aux plateformes (par exemple, YouTube, Zoom, TikTok) s'appuient généralement sur des modèles universels adaptés à un usage quotidien, mais leur précision reste incohérente.

Outils de sous-titrage professionnels (par exemple, Easysub) combinent l'optimisation post-traitement avec la relecture humaine après reconnaissance, offrant une plus grande précision dans les environnements bruyants et les contextes complexes.

Comparaison de la précision du sous-titrage automatique sur différentes plateformes

| Plateforme/Outil | Plage de précision | Points forts | Limites |

|---|---|---|---|

| Youtube | 60% – 90% | Large couverture, support multilingue, idéal pour les créateurs | Taux d'erreur élevé avec les accents, le bruit ou les termes techniques |

| Zoom / Google Meet | 70% – 85% | Sous-titres en temps réel, adaptés à l'éducation et aux réunions | Erreurs dans les scénarios multi-locuteurs ou multilingues |

| Microsoft Teams | 75% – 88% | Intégré au lieu de travail, prend en charge la transcription en direct | Faibles performances dans les langues non anglaises, difficultés avec le jargon |

| TikTok / Instagram | 65% – 80% | Génération automatique rapide, idéale pour les vidéos courtes | Privilégie la vitesse à la précision, fautes de frappe/erreurs de reconnaissance fréquentes |

| Easysub (Pro Tool) | 90% – 98% | IA + post-édition, performant pour le contenu multilingue et technique, haute précision | Peut nécessiter un investissement par rapport aux plateformes gratuites |

Comment améliorer la précision des sous-titres automatiques ?

Bien que la précision des sous-titres automatiques se soit considérablement améliorée ces dernières années, obtenir des sous-titres de meilleure qualité dans la pratique nécessite une optimisation sur plusieurs aspects :

- Améliorer la qualité audio:L’utilisation de microphones de haute qualité et la réduction du bruit de fond constituent la base de l’amélioration de la précision de la reconnaissance.

- Optimiser le style de parole:Maintenez un rythme de parole modéré et une prononciation claire, en évitant les interruptions simultanées ou les chevauchements de discours entre plusieurs locuteurs.

- Sélectionnez les outils appropriés:Les plateformes gratuites répondent aux besoins généraux, mais outils de sous-titrage professionnels (comme Easysub) sont recommandés pour le contenu éducatif, commercial ou spécialisé.

- Relecture hybride humain-IA:Une fois les sous-titres générés automatiquement produits, effectuez une vérification manuelle pour garantir que les sous-titres finaux approchent la précision 100%.

Tendances futures du sous-titrage automatique

Les sous-titres automatiques évoluent rapidement vers plus de précision, d'intelligence et de personnalisation. Grâce aux progrès de l'apprentissage profond et des grands modèles linguistiques (LLM), les systèmes atteindront une reconnaissance plus stable des accents, des langues moins connues et des environnements bruyants. Ils corrigeront également automatiquement les homophones, identifieront la terminologie spécialisée et reconnaîtront le vocabulaire spécifique à un secteur d'activité grâce à la compréhension contextuelle. Parallèlement, les outils comprendront mieux les utilisateurs : ils distingueront les locuteurs, souligneront les points clés, adapteront l'affichage aux habitudes de lecture et fourniront des sous-titres multilingues en temps réel pour les flux en direct et les contenus à la demande. L'intégration étroite avec les logiciels de montage et les plateformes de streaming en direct permettra également un flux de travail “ génération-épreuve-publication ” quasi transparent.

Tout au long de ce chemin évolutif, Easysub L'entreprise se positionne pour intégrer “ essai gratuit + mise à niveau professionnelle ” à un flux de travail complet : reconnaissance plus précise, traduction multilingue, exportation aux formats standards et collaboration en équipe. Intégrant en permanence les dernières fonctionnalités d'IA, elle répond aux besoins de communication mondiaux des créateurs, des enseignants et des entreprises. En résumé, l'avenir du sous-titrage automatique ne se résume pas à une plus grande précision, mais à une plus grande adéquation avec vos besoins : il passe du statut d'outil auxiliaire à celui d'infrastructure fondamentale de la communication intelligente.

Commencez à utiliser EasySub pour améliorer vos vidéos dès aujourd'hui

À l’ère de la mondialisation des contenus et de l’explosion des vidéos de courte durée, le sous-titrage automatisé est devenu un outil essentiel pour améliorer la visibilité, l’accessibilité et le professionnalisme des vidéos.

Avec des plateformes de génération de sous-titres IA comme Easysub, Les créateurs de contenu et les entreprises peuvent produire des sous-titres vidéo de haute qualité, multilingues et synchronisés avec précision en moins de temps, améliorant considérablement l'expérience de visionnage et l'efficacité de la distribution.

À l'ère de la mondialisation des contenus et de l'explosion des vidéos courtes, le sous-titrage automatisé est devenu un outil essentiel pour améliorer la visibilité, l'accessibilité et le professionnalisme des vidéos. Grâce aux plateformes de génération de sous-titres par IA comme Easysub, les créateurs de contenu et les entreprises peuvent produire des sous-titres vidéo de haute qualité, multilingues et parfaitement synchronisés en un temps record, améliorant ainsi considérablement l'expérience de visionnage et l'efficacité de la distribution.

Que vous soyez débutant ou créateur expérimenté, Easysub peut accélérer et dynamiser votre contenu. Essayez Easysub gratuitement dès maintenant et découvrez l'efficacité et l'intelligence du sous-titrage par IA, permettant à chaque vidéo de toucher un public international, au-delà des frontières linguistiques !

Laissez l'IA dynamiser votre contenu en quelques minutes seulement !

👉Cliquez ici pour un essai gratuit : easyssub.com

Merci d'avoir lu ce blog. N'hésitez pas à nous contacter pour plus de questions ou besoins de personnalisation !