มี AI ที่สามารถสร้างคำบรรยายได้หรือไม่

ในยุคปัจจุบันที่การผลิตวิดีโอ การศึกษาออนไลน์ และเนื้อหาสื่อสังคมออนไลน์เติบโตอย่างรวดเร็ว การสร้างคำบรรยายจึงกลายเป็นส่วนสำคัญในการยกระดับประสบการณ์การรับชมและขยายขอบเขตการเผยแพร่ ในอดีต การสร้างคำบรรยายมักทำโดยการถอดเสียงและตัดต่อด้วยมือ ซึ่งใช้เวลานาน ใช้แรงงานมาก และมีค่าใช้จ่ายสูง แต่ในปัจจุบัน ด้วยการพัฒนาเทคโนโลยีปัญญาประดิษฐ์ (AI) ในการจดจำเสียงและการประมวลผลภาษาธรรมชาติ การสร้างคำบรรยายได้เข้าสู่ยุคอัตโนมัติแล้ว ดังนั้น, มี AI ที่สามารถสร้างคำบรรยายได้หรือไม่? มันทำงานอย่างไร? บทความนี้จะอธิบายให้คุณฟังอย่างละเอียด.

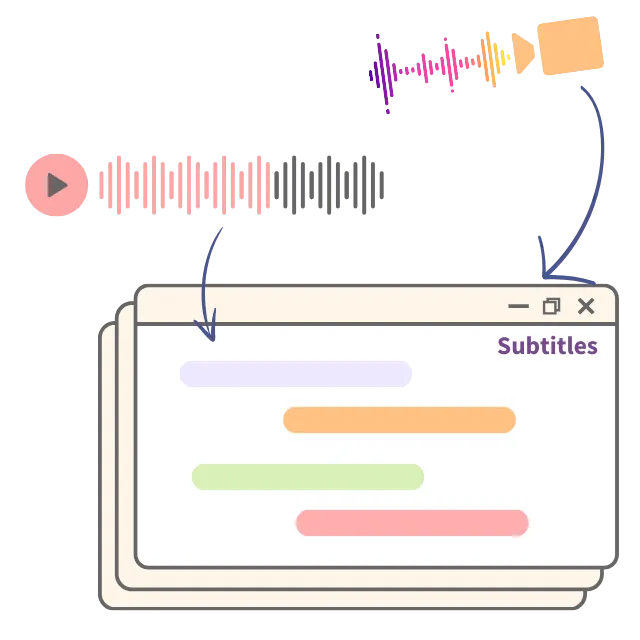

คำบรรยายที่สร้างโดย AI หมายถึงกระบวนการรับรู้และแปลงเนื้อหาที่พูดในวิดีโอหรือเสียงเป็นข้อความโดยอัตโนมัติ พร้อมกับซิงโครไนซ์กับเฟรมวิดีโออย่างแม่นยำ และสร้างไฟล์คำบรรยายที่แก้ไขและส่งออกได้ (เช่น SRT, VTT เป็นต้น) หลักการสำคัญของเทคโนโลยีนี้ประกอบด้วยขั้นตอนทางเทคนิคสองขั้นตอนหลักๆ ดังต่อไปนี้:

| รายการ | วิธีการแบบดั้งเดิม | วิธีการอัตโนมัติ AI |

|---|---|---|

| การมีส่วนร่วมของมนุษย์ | ต้องใช้ผู้ถอดเสียงมืออาชีพในการป้อนประโยคต่อประโยค | การจดจำและสร้างอัตโนมัติเต็มรูปแบบ |

| ประสิทธิภาพเวลา | ประสิทธิภาพการผลิตต่ำ ใช้เวลานาน | สร้างอย่างรวดเร็ว เสร็จภายในไม่กี่นาที |

| ภาษาที่รองรับ | โดยปกติต้องใช้เครื่องถอดเสียงหลายภาษา | รองรับการรู้จำและการแปลหลายภาษา |

| ต้นทุนการลงทุน | ต้นทุนแรงงานสูง | ลดต้นทุน เหมาะกับการใช้งานขนาดใหญ่ |

| ความแม่นยำ | สูงแต่ขึ้นอยู่กับความชำนาญของมนุษย์ | เพิ่มประสิทธิภาพอย่างต่อเนื่องผ่านการฝึกอบรมโมเดล AI |

เมื่อเทียบกับการถอดเสียงแบบแมนนวลแบบดั้งเดิม การสร้างคำบรรยายด้วย AI ช่วยเพิ่มประสิทธิภาพการผลิตและความสามารถในการเผยแพร่ได้อย่างมาก สำหรับผู้ใช้ เช่น ผู้สร้างคอนเทนต์ องค์กรสื่อ และแพลตฟอร์มการศึกษา เครื่องมือคำบรรยายด้วย AI กำลังค่อยๆ กลายเป็นโซลูชันสำคัญที่ช่วยเพิ่มประสิทธิภาพการทำงานและเพิ่มการเข้าถึงเนื้อหา.

คำตอบคือ: ใช่ ตอนนี้ AI สามารถสร้างคำบรรยายได้อย่างมีประสิทธิภาพและแม่นยำด้วยตัวเอง. ปัจจุบันมีแพลตฟอร์มมากมาย เช่น YouTube, ซูม และ อีซี่ซับ ได้นำเทคโนโลยีคำบรรยาย AI มาใช้อย่างแพร่หลาย ช่วยลดภาระงานในการถอดเสียงด้วยมือได้อย่างมาก และทำให้การผลิตคำบรรยายรวดเร็วและแพร่หลายมากขึ้น.

แกนหลักของการสร้างคำบรรยายอัตโนมัติด้วย AI อาศัยเทคโนโลยีต่อไปนี้:

การรู้จำเสียงพูด (ASR) เป็นขั้นตอนแรกที่สำคัญที่สุดในกระบวนการสร้างคำบรรยาย หน้าที่ของ ASR คือการถอดเสียงมนุษย์ในเสียงให้เป็นข้อความที่อ่านได้โดยอัตโนมัติ ไม่ว่าจะเป็นเนื้อหาวิดีโอที่เป็นคำพูด บทสนทนา หรือการสัมภาษณ์ ASR สามารถแปลงเสียงเป็นข้อความได้อย่างรวดเร็ว ซึ่งเป็นการวางรากฐานสำหรับการสร้าง การแก้ไข และการแปลคำบรรยายในลำดับต่อไป.

เมื่อมนุษย์พูด เสียงจะถูกแปลงเป็นสัญญาณคลื่นเสียงอย่างต่อเนื่อง ระบบ ASR จะแบ่งสัญญาณนี้ออกเป็นช่วงเวลาสั้นๆ (เช่น แต่ละเฟรมใช้เวลา 10 มิลลิวินาที) และใช้เครือข่ายประสาทเทียมเชิงลึก (เช่น DNN, CNN หรือ Transformer) เพื่อวิเคราะห์แต่ละเฟรมและระบุหน่วยพื้นฐานของเสียงพูดที่สอดคล้องกัน ซึ่งเป็น หน่วยเสียง. โมเดลอะคูสติกสามารถจดจำสำเนียง ความเร็วในการพูดของผู้พูดที่แตกต่างกัน และคุณลักษณะการพูดในเสียงรบกวนพื้นหลังต่างๆ ได้โดยผ่านการฝึกอบรมบนข้อมูลการพูดที่มีป้ายกำกับจำนวนมาก.

หลังจากที่แบบจำลองการเรียนรู้และแบบจำลองภาษาได้สร้างชุดผลลัพธ์ที่เป็นไปได้ขึ้นมาโดยอิสระแล้ว หน้าที่ของตัวถอดรหัสคือการรวมผลลัพธ์เหล่านั้นเข้าด้วยกันและค้นหาลำดับคำที่สมเหตุสมผลและเหมาะสมกับบริบทมากที่สุด กระบวนการนี้คล้ายกับการค้นหาเส้นทางและการเพิ่มความน่าจะเป็นสูงสุด อัลกอริทึมที่ใช้กันทั่วไป ได้แก่ อัลกอริทึม Viterbi และอัลกอริทึม Beam Search ข้อความผลลัพธ์สุดท้ายคือเส้นทางที่ "น่าเชื่อถือที่สุด" ในบรรดาเส้นทางที่เป็นไปได้ทั้งหมด.

เทคโนโลยี ASR สมัยใหม่ได้รับการพัฒนาโดยใช้โมเดลการเรียนรู้เชิงลึก และถูกนำไปใช้อย่างแพร่หลายบนแพลตฟอร์มต่างๆ เช่น YouTube, Douyin และ Zoom ต่อไปนี้คือระบบ ASR หลักบางส่วน:

ระบบเหล่านี้ไม่เพียงแต่สามารถจดจำเสียงพูดที่ชัดเจนเท่านั้น แต่ยังจัดการกับความแตกต่างของสำเนียง เสียงพื้นหลัง และสถานการณ์ที่มีผู้พูดหลายคนได้อีกด้วย AI สามารถสร้างฐานข้อมูลข้อความที่แม่นยำได้อย่างรวดเร็วด้วยการจดจำเสียงพูด ช่วยประหยัดเวลาและต้นทุนในการผลิตคำบรรยายได้อย่างมาก โดยลดความจำเป็นในการถอดเสียงด้วยตนเอง.

การซิงโครไนซ์แกนเวลาเป็นขั้นตอนสำคัญอย่างหนึ่งในการสร้างคำบรรยาย หน้าที่ของมันคือการจัดเรียงข้อความที่สร้างขึ้นโดยการรู้จำเสียงพูดให้ตรงกับตำแหน่งเวลาที่เฉพาะเจาะจงในเสียงอย่างแม่นยำ เพื่อให้แน่ใจว่าคำบรรยายสามารถ "ติดตามผู้พูด" ได้อย่างถูกต้องและปรากฏบนหน้าจอในเวลาที่เหมาะสม.

ในแง่ของการนำไปใช้ทางเทคนิค การซิงโครไนซ์แกนเวลาโดยทั่วไปจะอาศัยวิธีการที่เรียกว่า “การจัดเรียงแบบบังคับ” เทคโนโลยีนี้ใช้ผลลัพธ์ข้อความที่รับรู้แล้วมาจับคู่กับรูปคลื่นเสียง โดยใช้แบบจำลองทางเสียงในการวิเคราะห์เนื้อหาเสียงทีละเฟรมและคำนวณตำแหน่งเวลาที่แต่ละคำหรือแต่ละหน่วยเสียงปรากฏในเสียง.

ระบบคำบรรยาย AI ขั้นสูงบางระบบ เช่น OpenAI Whisper หรือ Kaldi พวกมันสามารถบรรลุ การจัดตำแหน่งระดับคำ, และถึงขั้นแม่นยำถึงขนาดคำพยางค์หรือตัวอักษรแต่ละตัวเลยทีเดียว.

การแปลอัตโนมัติ (MT) เป็นองค์ประกอบสำคัญในระบบคำบรรยาย AI สำหรับการจัดทำคำบรรยายหลายภาษา หลังจากที่ระบบรู้จำเสียงพูด (ASR) แปลงเนื้อหาเสียงเป็นข้อความในภาษาต้นฉบับแล้ว เทคโนโลยีการแปลอัตโนมัติจะแปลงข้อความเหล่านี้เป็นภาษาเป้าหมายได้อย่างแม่นยำและมีประสิทธิภาพ.

ในแง่ของหลักการพื้นฐาน เทคโนโลยีการแปลด้วยเครื่องจักรสมัยใหม่นั้นอาศัยหลักการหลักๆ ดังต่อไปนี้ แบบจำลองการแปลด้วยเครื่องประสาท (NMT). โดยเฉพาะอย่างยิ่งโมเดลการเรียนรู้เชิงลึกที่ใช้สถาปัตยกรรม Transformer ในระหว่างขั้นตอนการฝึกฝน โมเดลนี้จะรับข้อมูลป้อนเข้าเป็นคลังข้อมูลคู่ขนานสองภาษาหรือหลายภาษาจำนวนมาก ผ่านโครงสร้าง "ตัวเข้ารหัส-ตัวถอดรหัส" (Encoder-Decoder) มันจะเรียนรู้ความสัมพันธ์ระหว่างภาษาต้นทางและภาษาเป้าหมาย.

การประมวลผลภาษาธรรมชาติ (NLP) เป็นโมดูลหลักของระบบสร้างคำบรรยาย AI เพื่อความเข้าใจภาษา ส่วนใหญ่จะใช้เพื่อจัดการงานต่างๆ เช่น การแบ่งส่วนประโยค การวิเคราะห์ความหมาย การปรับปรุงรูปแบบ และการปรับปรุงการอ่านของเนื้อหา หากคำบรรยายไม่ได้รับการประมวลผลภาษาอย่างถูกต้อง อาจเกิดปัญหาต่างๆ เช่น ประโยคยาวๆ แบ่งส่วนไม่ถูกต้อง ความสับสนเชิงตรรกะ หรือความยากลำบากในการอ่าน.

คำบรรยายแตกต่างจากเนื้อหาหลัก คำบรรยายต้องปรับให้เข้ากับจังหวะการอ่านบนหน้าจอ และโดยปกติแล้วแต่ละบรรทัดต้องมีจำนวนคำและความหมายที่สมบูรณ์เหมาะสม ดังนั้น ระบบจะใช้วิธีการต่างๆ เช่น การรู้จำเครื่องหมายวรรคตอน การวิเคราะห์ชนิดของคำ และการตัดสินโครงสร้างไวยากรณ์ เพื่อแบ่งประโยคยาวๆ ให้เป็นประโยคหรือวลีสั้นๆ ที่อ่านง่ายขึ้นโดยอัตโนมัติ ซึ่งจะช่วยเพิ่มความเป็นธรรมชาติของจังหวะคำบรรยาย.

แบบจำลอง NLP วิเคราะห์บริบทเพื่อระบุคำสำคัญ โครงสร้างประธาน-กริยา และความสัมพันธ์เชิงอ้างอิง ฯลฯ และกำหนดความหมายที่แท้จริงของย่อหน้า ซึ่งมีความสำคัญอย่างยิ่งสำหรับการจัดการกับสำนวนทั่วไป เช่น ภาษาพูด การละเว้น และความกำกวม ตัวอย่างเช่น ในประโยค “เขาพูดเมื่อวานนี้ว่าเขาจะไม่มาวันนี้” ระบบจำเป็นต้องเข้าใจว่าวลี “วันนี้” หมายถึงช่วงเวลาใดโดยเฉพาะ.

รวมถึงการปรับมาตรฐานการใช้ตัวพิมพ์ใหญ่ การแปลงตัวเลข การระบุคำนามเฉพาะ และการกรองเครื่องหมายวรรคตอน เป็นต้น การเพิ่มประสิทธิภาพเหล่านี้สามารถทำให้คำบรรยายดูเรียบร้อยขึ้นและแสดงออกมาอย่างมืออาชีพมากขึ้น.

ระบบ NLP สมัยใหม่มักใช้โมเดลภาษาที่ผ่านการฝึกอบรมไว้ล่วงหน้า เช่น BERT, RoBERTa, GPT เป็นต้น เป็นหลัก โมเดลเหล่านี้มีศักยภาพที่แข็งแกร่งในการทำความเข้าใจบริบทและการสร้างภาษา และสามารถปรับให้เข้ากับนิสัยการใช้ภาษาในหลายภาษาและสถานการณ์ต่างๆ ได้โดยอัตโนมัติ.

แพลตฟอร์มคำบรรยาย AI บางตัวยังปรับการแสดงออกของคำบรรยายตามกลุ่มเป้าหมาย (เช่น เด็กวัยเรียน เจ้าหน้าที่ด้านเทคนิค และผู้พิการทางการได้ยิน) ซึ่งแสดงให้เห็นถึงระดับสติปัญญาทางภาษาที่สูงกว่า.

การผลิตคำบรรยายแบบดั้งเดิมจำเป็นต้องถอดเสียงแต่ละประโยคด้วยตนเอง การแบ่งประโยค การปรับไทม์ไลน์ และการตรวจสอบภาษา กระบวนการนี้ใช้เวลานานและต้องใช้แรงงานมาก ระบบคำบรรยาย AI ด้วยเทคโนโลยีการจดจำเสียง การจัดตำแหน่งอัตโนมัติ และการประมวลผลภาษา สามารถทำงานที่ปกติใช้เวลาหลายชั่วโมงให้เสร็จได้ภายในเวลาเพียงไม่กี่นาที.

ระบบสามารถระบุคำศัพท์ คำนามเฉพาะ และสำนวนที่ใช้บ่อยได้โดยอัตโนมัติ ช่วยลดข้อผิดพลาดด้านการสะกดคำและไวยากรณ์ ขณะเดียวกันก็รักษาความสม่ำเสมอของการแปลคำศัพท์และการใช้คำตลอดทั้งวิดีโอ หลีกเลี่ยงปัญหาที่พบบ่อยเกี่ยวกับรูปแบบที่ไม่สอดคล้องกันหรือการใช้คำที่สับสนซึ่งมักเกิดขึ้นในคำบรรยายที่มนุษย์สร้างขึ้นได้อย่างมีประสิทธิภาพ.

ด้วยความช่วยเหลือของเทคโนโลยีการแปลด้วยเครื่อง (MT) ระบบคำบรรยาย AI สามารถ แปลภาษาต้นฉบับเป็นคำบรรยายภาษาเป้าหมายหลายภาษาโดยอัตโนมัติ และแสดงผลเวอร์ชันหลายภาษาได้เพียงคลิกเดียว แพลตฟอร์มต่างๆ เช่น YouTube, Easysub และ Descript ต่างรองรับการสร้างและจัดการคำบรรยายหลายภาษาพร้อมกัน.

เทคโนโลยีคำบรรยาย AI ได้พลิกโฉมการผลิตคำบรรยายจาก “การใช้แรงงานคน” ไปสู่ “การผลิตอัจฉริยะ” ไม่เพียงแต่ช่วยประหยัดต้นทุนและปรับปรุงคุณภาพเท่านั้น แต่ยังทำลายอุปสรรคด้านภาษาและภูมิภาคในการสื่อสารอีกด้วย สำหรับทีมงานและบุคคลที่ต้องการเผยแพร่เนื้อหาอย่างมีประสิทธิภาพ เป็นมืออาชีพ และครอบคลุมทั่วโลก, การใช้ AI เพื่อสร้างคำบรรยายกลายเป็นทางเลือกที่หลีกเลี่ยงไม่ได้ตามแนวโน้ม.

| ประเภทผู้ใช้ | กรณีการใช้งานที่แนะนำ | เครื่องมือคำบรรยายที่แนะนำ |

|---|---|---|

| ผู้สร้างวิดีโอ / ยูทูบเบอร์ | วิดีโอ YouTube, vlogs, วิดีโอสั้น | Easysub, CapCut, ดีสคริปต์ |

| ผู้สร้างเนื้อหาทางการศึกษา | หลักสูตรออนไลน์ บทบรรยายที่บันทึกไว้ วิดีโอการเรียนรู้แบบไมโคร | Easysub, Sonix, Veed.io |

| บริษัทข้ามชาติ / ทีมการตลาด | การโปรโมตผลิตภัณฑ์ โฆษณาหลายภาษา เนื้อหาการตลาดเฉพาะพื้นที่ | อีซี่ซับ, แฮปปี้ สไครบ์, ทรินต์ |

| บรรณาธิการข่าว/สื่อ | การออกอากาศข่าว วิดีโอสัมภาษณ์ การบรรยายสารคดี | Whisper (โอเพนซอร์ส), AegiSub + Easysub |

| ครู / ผู้ฝึกอบรม | การถอดเสียงบทเรียนที่บันทึกไว้ การใส่คำบรรยายวิดีโอเพื่อการศึกษา | Easysub, Otter.ai, Notta |

| ผู้จัดการโซเชียลมีเดีย | คำบรรยายวิดีโอแบบสั้น การปรับแต่งเนื้อหา TikTok / Douyin | CapCut, Easysub, Veed.io |

| ผู้ใช้ที่มีความบกพร่องทางการได้ยิน / แพลตฟอร์มการเข้าถึง | คำบรรยายหลายภาษาเพื่อความเข้าใจที่ดีขึ้น | Easysub, Amara, YouTube คำบรรยายอัตโนมัติ |

คำบรรยาย AI เองก็เป็นเครื่องมือทางเทคนิค ความถูกต้องตามกฎหมายขึ้นอยู่กับว่าผู้ใช้ปฏิบัติตามลิขสิทธิ์ของเนื้อหาหรือไม่ Easysub ใช้วิธีการทางเทคนิคและการจัดการเพื่อช่วยให้ผู้ใช้ลดความเสี่ยงด้านลิขสิทธิ์และสนับสนุนการดำเนินงานที่เป็นไปตามกฎหมาย.

Easysub คือ เครื่องมือสร้างคำบรรยายอัตโนมัติ ขับเคลื่อนด้วยเทคโนโลยีปัญญาประดิษฐ์ ออกแบบมาโดยเฉพาะสำหรับผู้ใช้ เช่น ผู้สร้างวิดีโอ นักการศึกษา และนักการตลาดด้านเนื้อหา ผสานรวมฟังก์ชันหลักต่างๆ เช่น การรู้จำเสียงพูด (ASR) การรองรับหลายภาษา การแปลด้วยเครื่อง (MT) และการส่งออกคำบรรยาย สามารถถอดเสียงวิดีโอเป็นข้อความโดยอัตโนมัติ และสร้างคำบรรยายแกนเวลาที่แม่นยำได้ในเวลาเดียวกัน นอกจากนี้ยังรองรับการแปลหลายภาษาและสามารถ สร้างคำบรรยาย ในหลายภาษา เช่น จีน อังกฤษ ญี่ปุ่น และเกาหลี เพียงคลิกเดียว ช่วยปรับปรุงประสิทธิภาพการประมวลผลคำบรรยายได้อย่างมีนัยสำคัญ.

ไม่จำเป็นต้องมีประสบการณ์ด้านการผลิตคำบรรยาย ผู้ใช้เพียงแค่อัปโหลดไฟล์วิดีโอหรือไฟล์เสียง อินเทอร์เฟซใช้งานง่ายและเข้าใจง่าย และระบบสามารถจับคู่ภาษาและความเร็วในการพูดได้โดยอัตโนมัติ. ช่วยให้ผู้เริ่มต้นเริ่มต้นได้อย่างรวดเร็วและประหยัดเวลาในการแก้ไขสำหรับผู้ใช้มืออาชีพ.

นอกจากนี้ Easysub เวอร์ชันพื้นฐานยังมีช่วงทดลองใช้ฟรี ผู้ใช้สามารถสัมผัสประสบการณ์การใช้งานฟังก์ชันการสร้างคำบรรยายทั้งหมดได้โดยตรงหลังจากลงทะเบียน รวมถึงการแก้ไขข้อความและการส่งออก เหมาะสำหรับโครงการขนาดเล็กหรือการใช้งานส่วนบุคคล.

👉 คลิกที่นี่เพื่อทดลองใช้ฟรี: easyssub.com

ขอบคุณที่อ่านบล็อกนี้. อย่าลังเลที่จะติดต่อเราหากมีคำถามเพิ่มเติมหรือต้องการการปรับแต่ง!

คุณจำเป็นต้องแชร์วิดีโอบนโซเชียลมีเดียหรือไม่? วิดีโอของคุณมีคำบรรยายหรือไม่…

คุณต้องการทราบว่าตัวสร้างคำบรรยายอัตโนมัติที่ดีที่สุด 5 อันดับคืออะไร? มาและ…

สร้างวิดีโอได้ด้วยคลิกเดียว เพิ่มคำบรรยาย ถอดเสียง และอื่นๆ

เพียงอัปโหลดวิดีโอและรับคำบรรยายการถอดเสียงที่แม่นยำที่สุดโดยอัตโนมัติและรองรับมากกว่า 150+ ฟรี...

เว็บแอปฟรีสำหรับดาวน์โหลดคำบรรยายโดยตรงจาก Youtube, VIU, Viki, Vlive ฯลฯ

เพิ่มคำบรรยายด้วยตนเอง ถอดเสียงหรืออัปโหลดไฟล์คำบรรยายโดยอัตโนมัติ